"한빛미디어 서평단 <나는리뷰어다> 활동을 위해서 책을 협찬 받아 작성된 서평입니다."

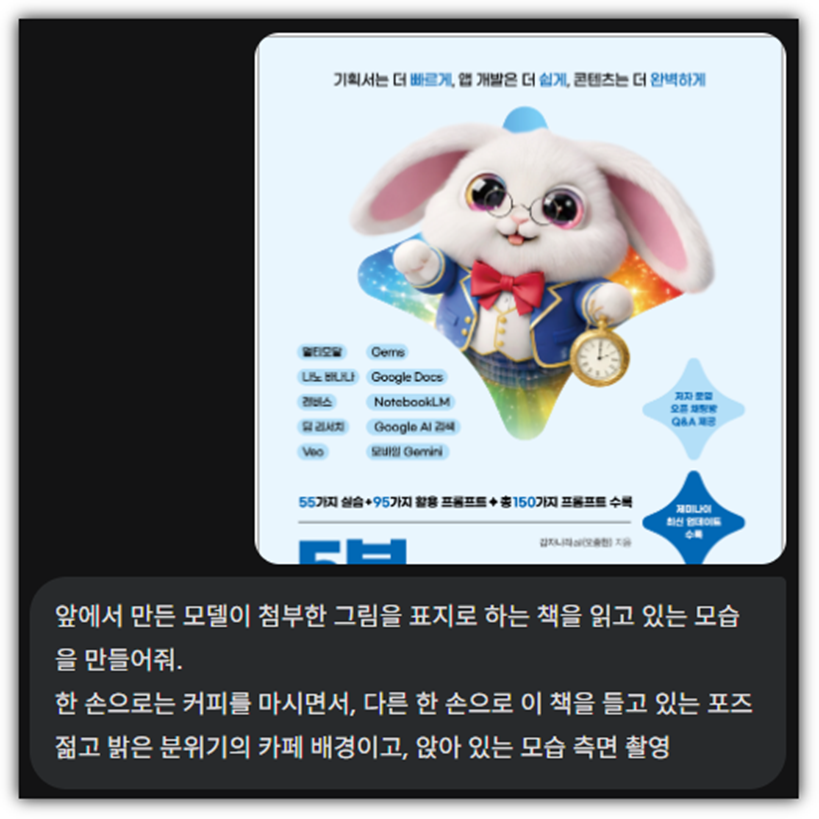

소프트웨어 개발자의 일자리를 위협하는 가장 강력한 코딩 에이전트 도구인 '클로드 코드'를 공부하기 위한 도서이다.

아랫 부분을 잘 살펴보기 바란다.

632 페이지 ... 그렇지, 마스터 하려면 이 정도 분량은 되어야 하는 것이지 !!!

'클로드 코드'에 대한 인기 덕분이기도 하겠지만,

이 책이 충분히 좋은 내용을 담고 있기에 1달도 안되어 2쇄까지도 이어지고 있는 것 같다.

'지은이의 말' 부분을 보면 이 책이 어떤 컨셉으로 작성된 것인지를 알려주고 있다.

책 표지에도 나와있지만, 이 책은 TDD/SDD에 대한 것을 중심으로 하되 도구로써 Claude Code를 사용하고 있는 것이다.

도구 보다는 TDD/SDD와 같은 개발 방법론을 중심으로 하고 있기에 다른 도구를 사용하는 경우에도 충분히 유용하다.

이 책에서 샘플로 진행하는 첫 번째 프로젝트는 'TODO 앱'이고 모습은 다음과 같다.

- https://tika-app.vercel.app/login

너무나 흔한 프로젝트이지만,

여기에서 보여주는 'TODO 앱'은 의외로 상당한 퀄리티를 보여준다.

물론 너무나 친절하게 소스코드도 Apache license로 공개해주고 있다.

- https://github.com/claude-code-expert/tika

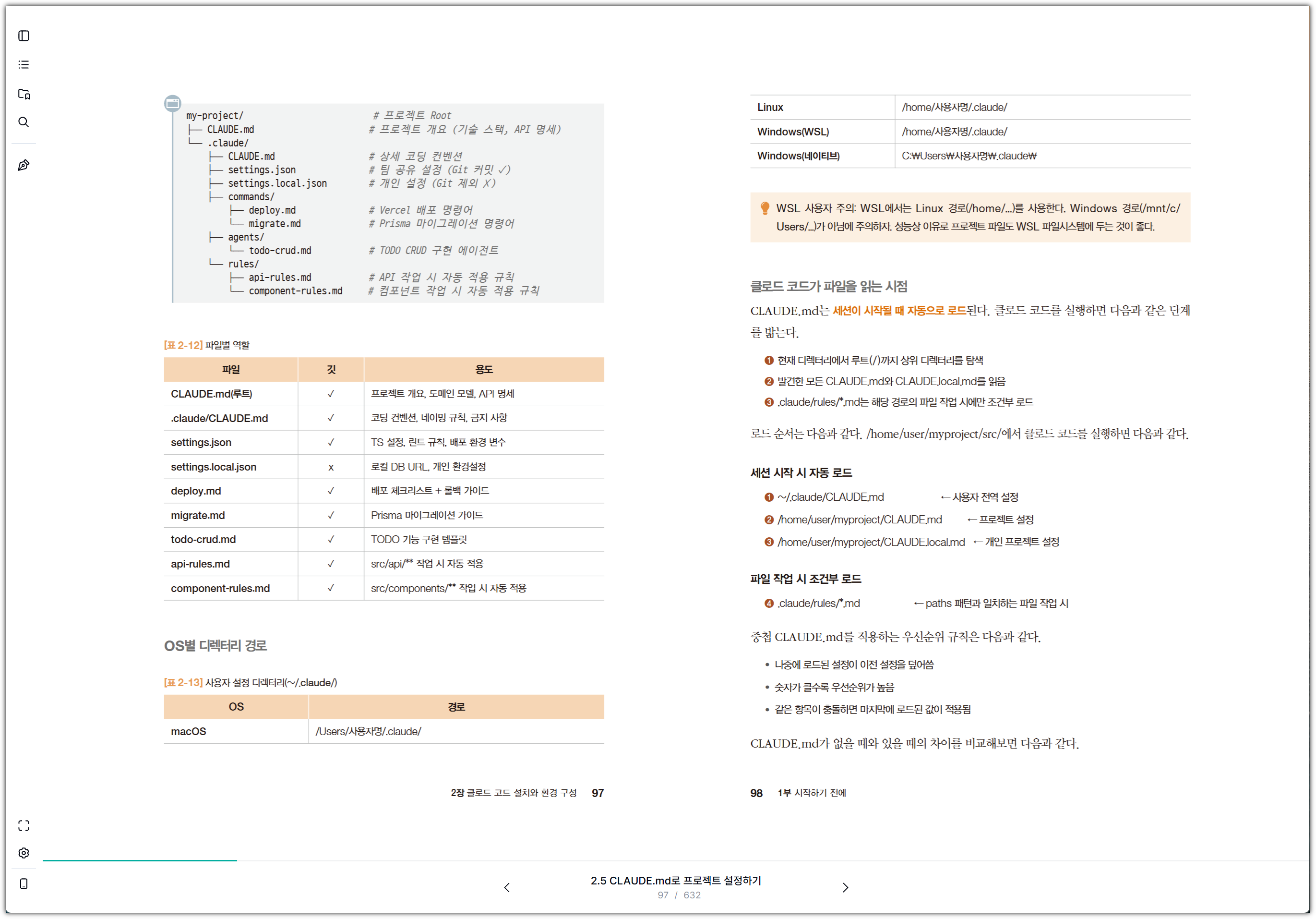

이외에도 개발에 필요한 필수 문서 체계(PRD, TRD, REQUIREMENTS), CLAUDE.md/AGENTS.md 템플릿,

스킬, 훅, 규칙, CLI 치트시트 등 정말 다양한 컨텐츠를 제공해주고 있으니 GitHub를 꼭 방문해보기 바란다.

- https://github.com/claude-code-expert/

Claude를 예전에 설치해서 사용해봤지만, 그 때에는 CLI만 설치했었는데

이번에 VSCode Extension까지 설치해보려 검색을 했는데 정말 다양한 Extension들이 나오는 것을 보니

Claude의 인기를 엿볼 수 있는 것 같다.

IDE가 유용할 때가 분명히 있기는 하지만,

왠지 CLI 인터페이스가 개인적으로는 더 선호된다 ^^

이 책의 내용을 살펴보면,

책 제목으로 '마스터'라는 말을 사용하는 것에 걸맞게 정말 충실한 컨텐츠를 담고 있다.

HOOK 하나를 설명하더라도, 개발 워크플로우에 적용할 수 있는 아이디어까지 사례를 보여주며 설명을 해주고

SDD에 대해서 설명하면서, GitHub에서 출시한 Spec Kit에 대해서도 필요에 의해 사용할 수 있도록 친절히 소개해주고 있다.

화면 디자인을 하면서 최근 이슈가 된 '클로드 디자인'에 대해서도 설명을 해줬으면 더 좋았겠지만

이 책의 출간일을 생각해보면 어쩔 수 없었을 것 같다 ^^

책을 전체적으로 살펴보면,

근래에 살펴본 수 많은 코딩 에이전트 책 중에서 가장 충실하고 알차게 작성된 책이라는 느낌이 강하게 들었다.

앞에서도 언급했지만,

책 제목에서 '마스터'라는 말을 사용한 분명한 이유가 있다 !!!

'Claude Code'를 이용해서 개발을 해보고 싶은 분이라면 교재로 사용하면서 착실하게 공부해보라고 권하고 싶다.

'Books' 카테고리의 다른 글

| [한빛] 하루 30분 나는 제미나이로 돈을 번다 - 정말 돈을 벌어보자 (0) | 2026.04.25 |

|---|---|

| [한빛] 5분 제미나이 - 구글 사용자라면 제미나이를 써야죠! (1) | 2026.03.28 |

| [한빛] "누구나 아는 나만 모르는 제미나이", 이제는 나도 아는 제미나이? (0) | 2026.02.23 |

| [한빛미디어] 일 잘하는 사람은 이렇게 챗GPT를 씁니다 (0) | 2025.12.28 |

| [한빛미디어] 바이브 코딩 너머 개발자 생존법 (1) | 2025.11.23 |